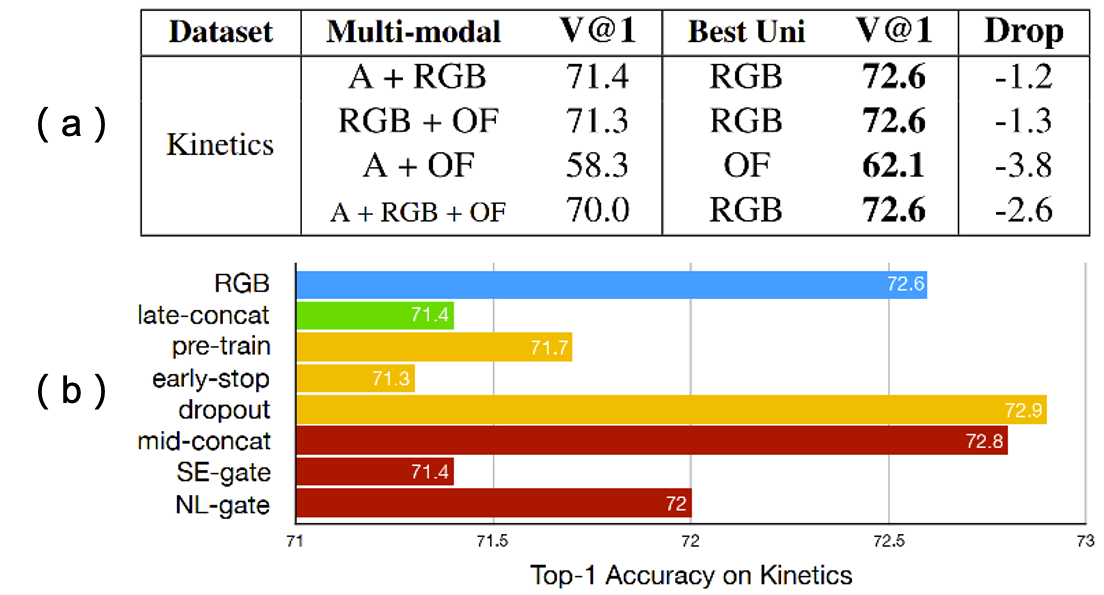

文章[1]的作者发现在多模态分类模型中,经常出现最好的单模态模型比多模态模型效果还好的情况,作者认为这是由于多模态模型的容量更大,因此更容易过拟合,并且由于不同模态的信息过拟合和泛化有着不同的节奏,如果用同一个优化策略进行优化,那么很可能得到的不是一个最佳的结果。也就是说作者认为目前的多模态融合方式还不是最合适的,因此在[1]中提出了一种基于多模态梯度混合的优化方式...

前言

文章[1]的作者发现在多模态分类模型中,经常出现最好的单模态模型比多模态模型效果还好的情况,作者认为这是由于多模态模型的容量更大,因此更容易过拟合,并且由于不同模态的信息过拟合和泛化有着不同的节奏,如果用同一个优化策略进行优化,那么很可能得到的不是一个最佳的结果。也就是说作者认为目前的多模态融合方式还不是最合适的,因此在[1]中提出了一种基于多模态梯度混合的优化方式。本文是笔者对该文的读后感和结合业务的一些认识,如有谬误请联系指出,本文遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接和本声明并且联系笔者,谢谢。

e-mail: FesianXu@gmail.com

github: https://github.com/FesianXu

知乎专栏: 计算机视觉/计算机图形理论与应用

微信公众号:机器学习杂货铺3号店

假如一个多模态分类模型由

容易知道对于单模态分类而言,其损失为:

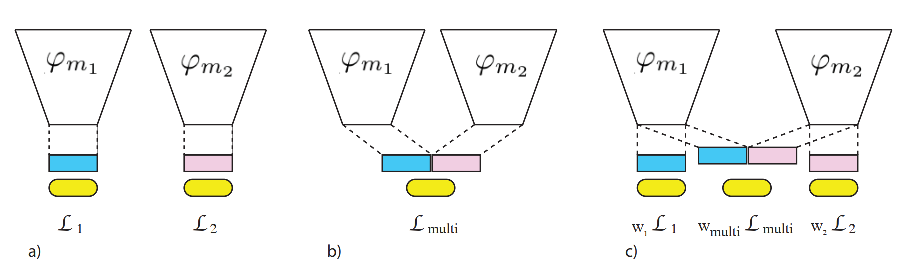

从理想情况看,由于多模态特征是由各个模态的特征拼接而成的,通过训练学习出合适的分类器参数

- 这些模态均衡系数

- 这些模态均衡系数是在线计算(动态更新)还是离线计算(静态计算后使用)

显然,均衡系数是一个超参数,单纯靠网格搜索或人工调参肯定不显示,而且无法解决关键问题2,也即是动态更新。因此作者提出了一种确定多模态均衡系数的方法。

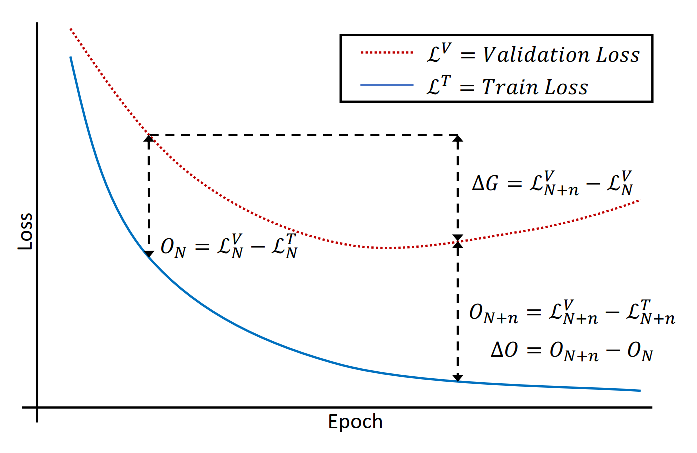

首先需要定义出一个度量以衡量该模态的过拟合与泛化情况,如Fig 1.3所示,作者定义了一种综合度量模型的过拟合与泛化情况的指标,其定义为过拟合程度与泛化程度的比值的绝对值,如式子(1-4)所示。其中

此时我们对每个模态的梯度

在实践中,再强调下,正如一开始所说的,

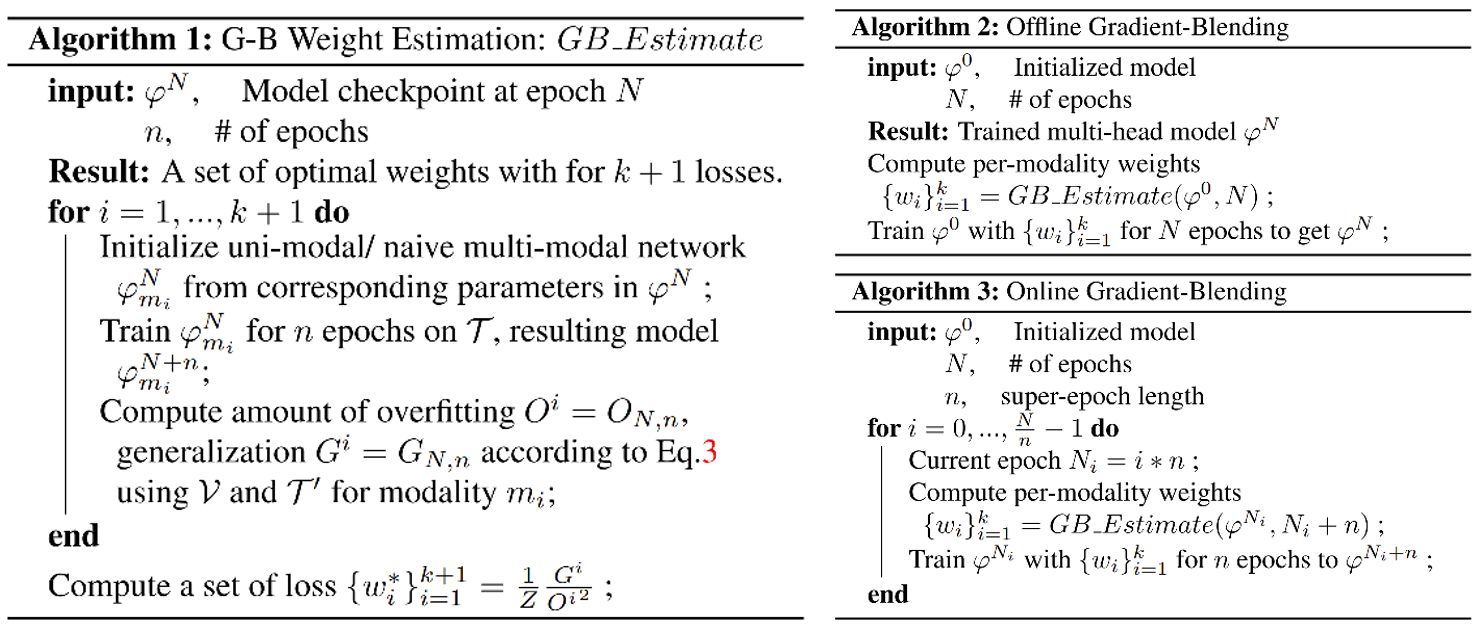

- 离线Gradient-Blending: 只计算一次模态均衡参数,并且在以后的训练中都一直固定。

- 在线Gradient-Blending: 将会定期(比如每n个epoch-也称之为super epoch)更新,并且用新的模态均衡参数参与后续的训练。

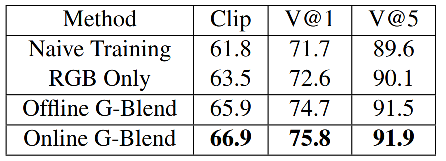

离在线GB算法和GB估计模态均衡参数的算法见Fig 1.4,显然,由于在线G-Blend需要隔一个super epoch就更新一次均衡参数,因此计算代价更大。作者发现采用了GB估计模态均衡参数后,无论是离线还是在线的G-Blend结合了多模态分类模型训练后,效果都比单模态模型有着显著的提升,并且离线效果仅仅比在线效果差一些,而在线G-Blend的计算代价比离线高,因此后续的消融实验都是用离线G-Blend展开的。

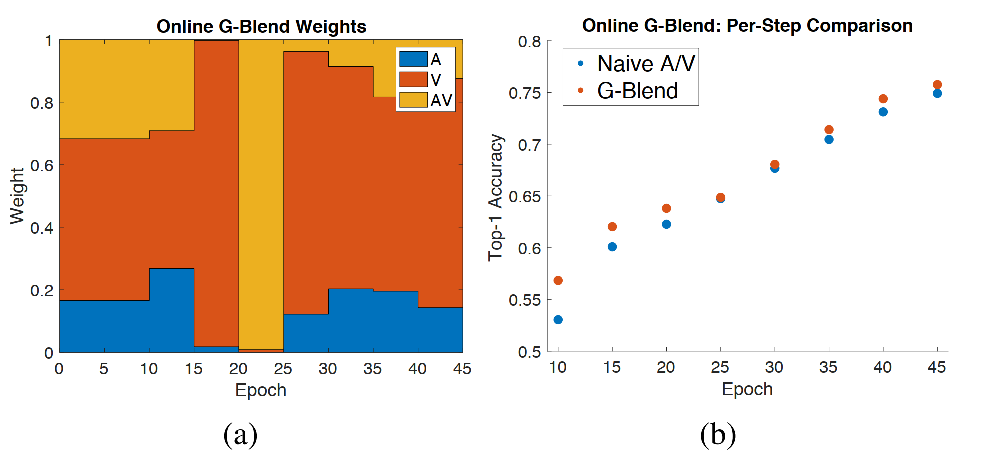

作者同样对比了不同epoch下在线G-Blend学习出的模态均衡参数的分布,如Fig 1.6(a)所示,可以发现其在不同epoch下其参数分布都不同,在15-20和20-25的时候甚至出现了Video部分和Audio-Video部分独占鳌头的情况,作者认为这是由于在不同训练阶段其过拟合和泛化行为特征都会改变,导致均衡参数也在一直变化,但是不管怎么样,其效果都会比不采用G-Blend的多模态分类训练更好,如Fig 1.6(b)所示。

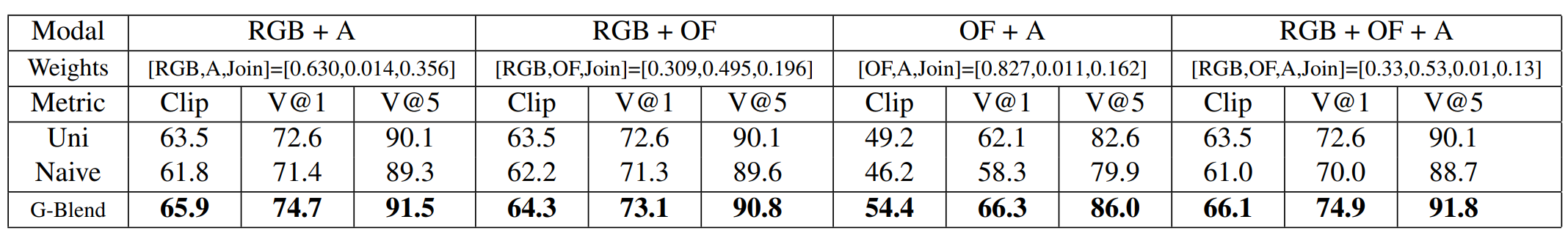

同样的,G-Blend不仅仅适用于Video/Audio这两个模态,还能在其他模态下生效,如Fig 1.7所示。

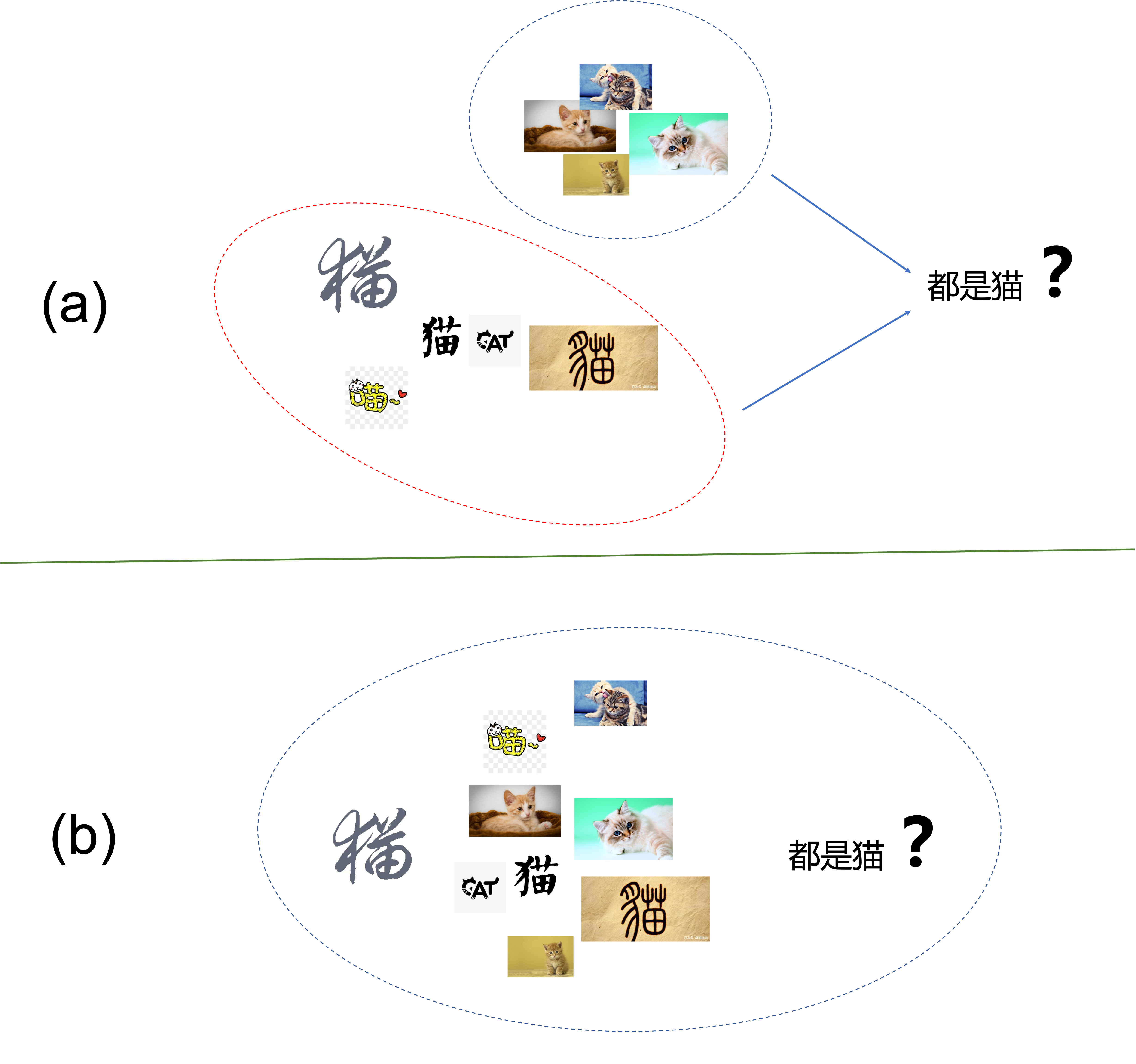

笔者从业务的角度上看,在进行图-文/视频-文匹配的时候,经常会采用双塔多模态匹配,最后对匹配损失进行优化的实践,如[3,4,5]。这个时候由于任务只关注了多模态匹配任务,而没有考虑维持单模态内的特征空间稳定性,此时容易导致单模态内的特征空间破损。如Fig 1.8所示,其中的Fig 1.8(a)图片虽然都和猫有关,但是显然一种是真的猫,一种是猫相关的书法作品,但是这两类的文本信息可能都包含有猫,在进行多模态匹配的时候如果不考虑单模态的损失,就会导致如Fig 1.8(b)所示的单模态特征空间破损,将一些细粒度的单模态知识给『遗忘』了。

Reference

[1]. Wang, W., Tran, D., & Feiszli, M. (2020). What makes training multi-modal classification networks hard?. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (pp. 12695-12705).

[2]. https://blog.csdn.net/LoseInVain/article/details/105545703, 《万字长文漫谈视频理解》 by FesianXu

[3]. https://fesian.blog.csdn.net/article/details/120364242, 《图文搜索系统中的多模态模型:将MoCo应用在多模态对比学习上》 by FesianXu

[4]. https://fesian.blog.csdn.net/article/details/119516894, 《CLIP-对比图文多模态预训练的读后感》 by FesianXu

[5]. https://fesian.blog.csdn.net/article/details/121699533, 《WenLan 2.0:一种不依赖Object Detection的大规模图文匹配预训练模型 & 数据+算力=大力出奇迹》 by FesianXu